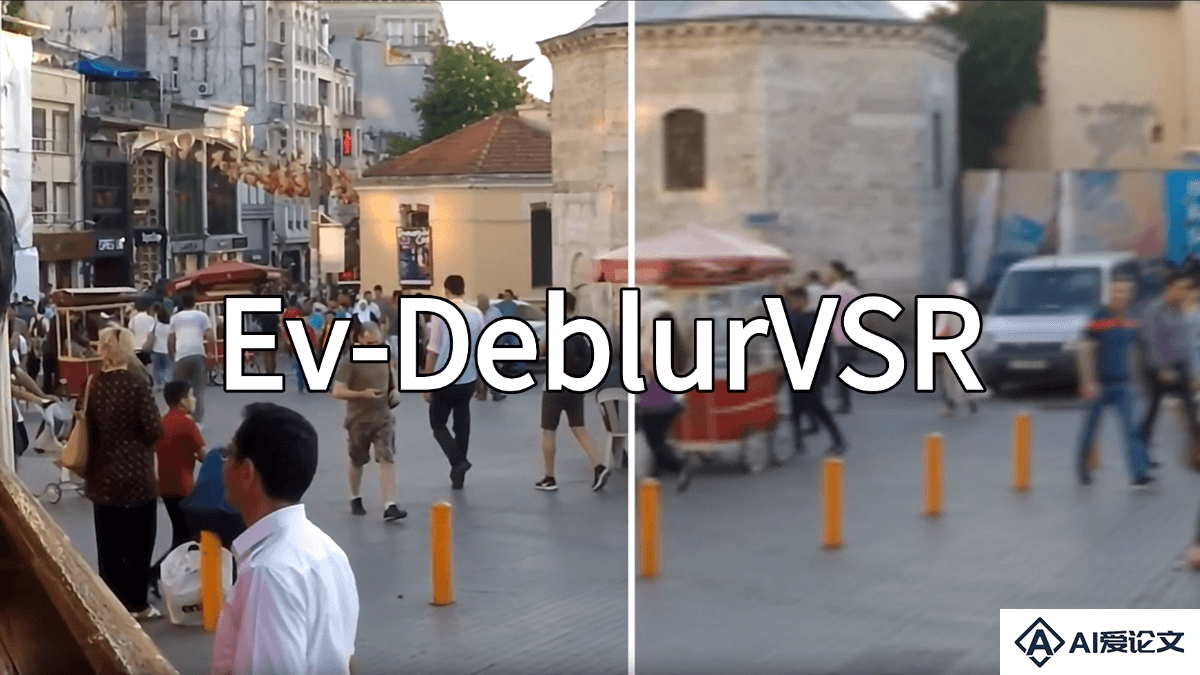

Ev-DeblurVSR – 中科大等机构推出的视频画面增强模型

来源:爱论文

时间:2025-05-14 16:01:13

Ev-DeblurVSR是什么

Ev-DeblurVSR是中国科学技术大学、合肥综合性国家科学中心人工智能研究所和新加坡国立大学联合推出的视频画面增强模型,能从低分辨率且模糊的视频输入中恢复出高分辨率、清晰的视频。Ev-DeblurVSR引入事件相机捕获的事件信号,用高时间分辨率和丰富的运动信息增强视频的去模糊和超分辨率性能。Ev-DeblurVSR的核心包括互惠特征去模糊模块(RFD)和混合可变形对齐模块(HDA),分别用在帧内去模糊和帧间对齐。Ev-DeblurVSR在多个数据集上表现出色,优于现有方法,尤其在真实数据上,具有更高的准确性和更快的处理速度。

Ev-DeblurVSR的主要功能

模糊视频超分辨率处理:将低分辨率且模糊的视频帧恢复为高分辨率且清晰的图像。基于事件相机数据辅助:借助事件相机捕捉的高时间分辨率和亮度变化信息,恢复丢失的运动细节和纹理。抗运动模糊和高动态范围:有效减少运动模糊,保留高对比度区域的细节,适用于运动场景和低光照场景。提供开发和测试支持:开源代码,提供预训练模型、测试数据集和脚本,方便开发者快速上手和验证效果。

Ev-DeblurVSR的技术原理

事件信号的分类与利用:帧内事件(Intra-frame Events):记录视频帧曝光时间内的运动信息,用在去模糊帧特征。帧间事件(Inter-frame Events):记录帧与帧之间的连续运动轨迹,用在时间对齐。互惠特征去模糊模块:基于帧内事件的运动信息去模糊视频帧特征,将视频帧的全局场景上下文信息反馈到事件特征中,增强事件特征的表达能力。基于多头通道注意力机制和交叉模态注意力机制实现帧与事件特征的互惠增强。混合可变形对齐模块:结合帧间事件和光流信息,用事件的连续运动轨迹和光流的空间信息,改善可变形对齐过程中的运动估计。基于事件引导对齐(Event-Guided Alignment, EGA)和光流引导对齐(Flow-Guided Alignment, FGA)两种分支实现对齐,用可变形卷积网络(DCN)完成最终的特征对齐。边缘增强损失函数:基于事件信号中的高频信息对像素重建误差进行加权,让模型更关注边缘和高频区域的恢复,提高恢复视频的细节和清晰度。

Ev-DeblurVSR的项目地址

项目官网:https://dachunkai.github.io/ev-deblurvsr.github.io/GitHub仓库:https://github.com/DachunKai/Ev-DeblurVSRarXiv技术论文:https://arxiv.org/pdf/2504.13042

Ev-DeblurVSR的应用场景

视频监控:提升模糊监控视频的清晰度,帮助更准确地识别细节。体育赛事:清晰还原快速运动场景,改善裁判判罚和观众观赛体验。自动驾驶:减少摄像头拍摄的模糊画面,为自动驾驶系统提供更清晰的环境感知。影视制作:修复拍摄条件不佳导致的模糊画面,提升影视作品质量。工业检测:改善因高速运动或设备抖动导致的模糊影像,提高工业检测的准确性。

相关资讯

相关资讯 2023-04-14

2023-04-14

下载

下载