MiniMind – 开源的AI模型训练工具,2小时训练25.8M小模型

来源:爱论文

时间:2025-03-11 12:59:03

MiniMind是什么

MiniMind 是开源的超小型语言模型项目,极低成本帮助个人开发者从零开始训练自己的语言模型。MiniMind 基于轻量级设计,最小版本仅需25.8M参数,体积仅为GPT-3的1/7000,适合在普通个人GPU上快速训练。MiniMind 提供完整的训练流程代码,包括预训练、监督微调、LoRA微调、强化学习和模型蒸馏,支持多模态能力(如视觉语言模型MiniMind-V),兼容主流框架如transformers和peft。MiniMind开源了高质量数据集和自定义分词器,适合LLM初学者快速入门。

MiniMind的主要功能

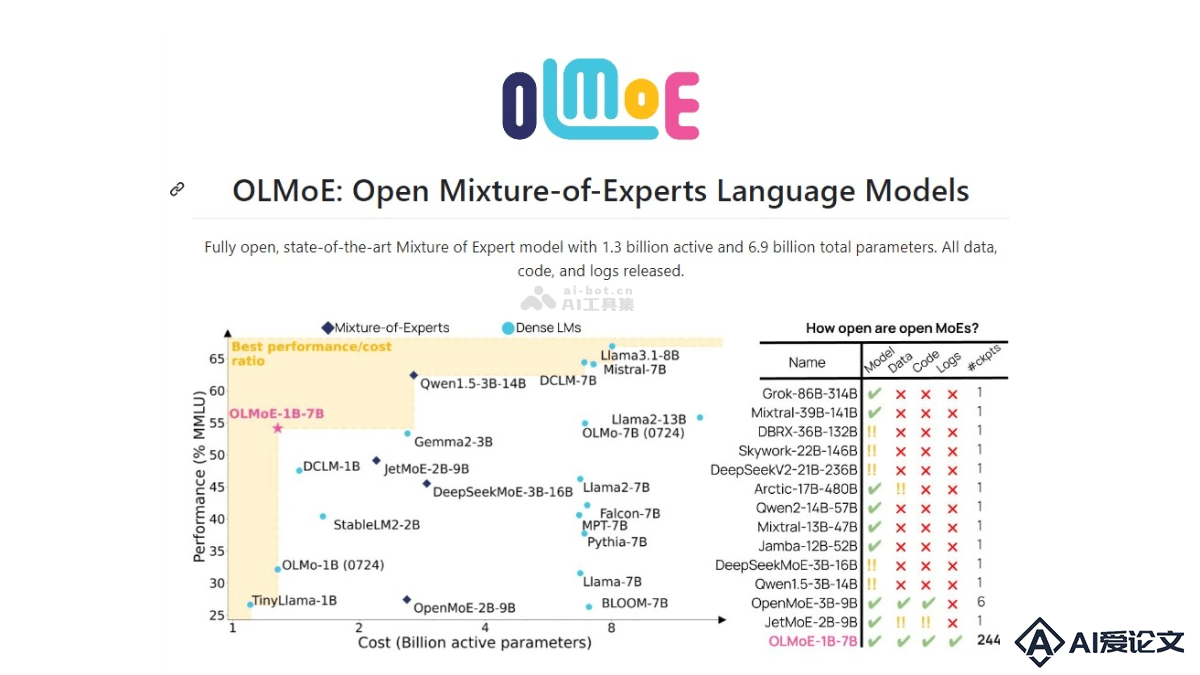

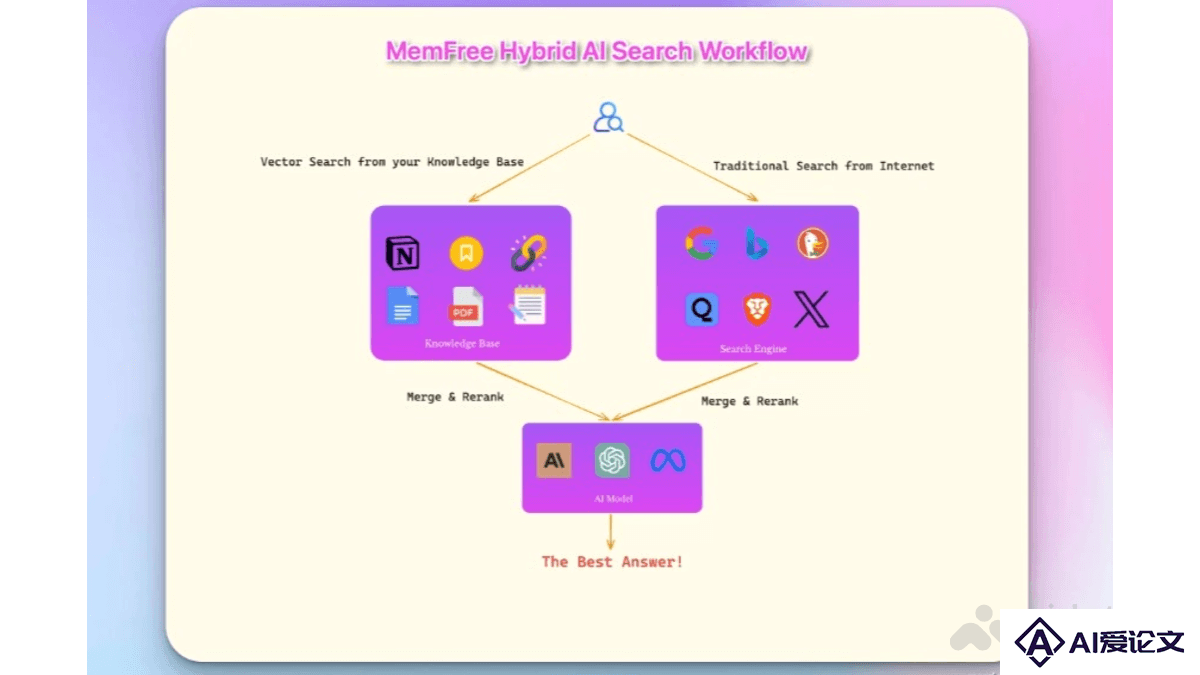

极低门槛的模型训练:低成本:仅需3元人民币的GPU租用成本(基于NVIDIA 3090)。快速训练:从零开始训练仅需2小时。轻量化设计:最小模型仅25.8M参数,适合在普通设备上运行。全流程开源:提供完整的训练代码,涵盖预训练、监督微调(SFT)、LoRA微调、直接偏好优化(DPO)和模型蒸馏。所有核心算法均基于PyTorch原生实现,不依赖第三方封装,易于学习和扩展。支持多种训练技术:混合专家(MoE)架构:动态分配计算资源,提升小模型的学习效率。直接偏好优化(DPO):无需复杂奖励模型,根据人类偏好优化模型输出。多模态扩展:支持视觉多模态(MiniMind-V),实现图片对话和图文生成。

MiniMind的技术原理

Transformer架构:基于Transformer的Decoder-Only结构,类似于GPT系列。用预标准化(Pre-Norm)和RMSNorm归一化方法,提升模型性能。基于SwiGLU激活函数替代ReLU,提高训练效率。混合专家(MoE)技术:在前馈网络(FFN)中引入混合专家模块,将计算资源动态分配给不同的“专家”。基于共享和隔离技术,提升小模型的学习能力和效率。轻量化的训练流程:预训练(Pretrain):用清洗后的高质量文本数据进行无监督学习,积累语言知识。监督微调(SFT):基于对话模板对模型进行有监督的微调,使其适应聊天场景。LoRA微调:基于低秩分解更新少量参数,快速适配特定领域或任务。直接偏好优化(DPO):基于人类偏好的标注数据,优化模型的输出质量。模型蒸馏:模仿大模型的输出,进一步提升小模型的性能。

MiniMind的项目地址

项目官网:https://jingyaogong.github.io/minimind/GitHub仓库:https://github.com/jingyaogong/minimindHuggingFace模型库:https://huggingface.co/collections/jingyaogong/minimind

MiniMind的应用场景

AI初学者和学生:对AI感兴趣的学生和初学者,完成毕业设计或参与学术研究。个人开发者和独立开发者:资源有限的个人开发者,快速开发和部署AI应用,适合实验和创新项目。垂直领域专业人士:医疗、法律、教育等领域的专业人士,开发如医疗问诊助手、法律咨询工具或教育辅导系统。小型团队和创业者:资源有限的小型团队或创业者,开发最小可行产品(MVP)或探索新的业务方向。爱好者和创意人士:对技术感兴趣但没有深厚背景的爱好者,开发智能聊天机器人、生成创意内容或探索多模态应用。

相关资讯

相关资讯 2023-04-14

2023-04-14

下载

下载