MME-CoT – 港中文等机构推出评估视觉推理能力的基准框架

来源:爱论文

时间:2025-03-14 11:42:56

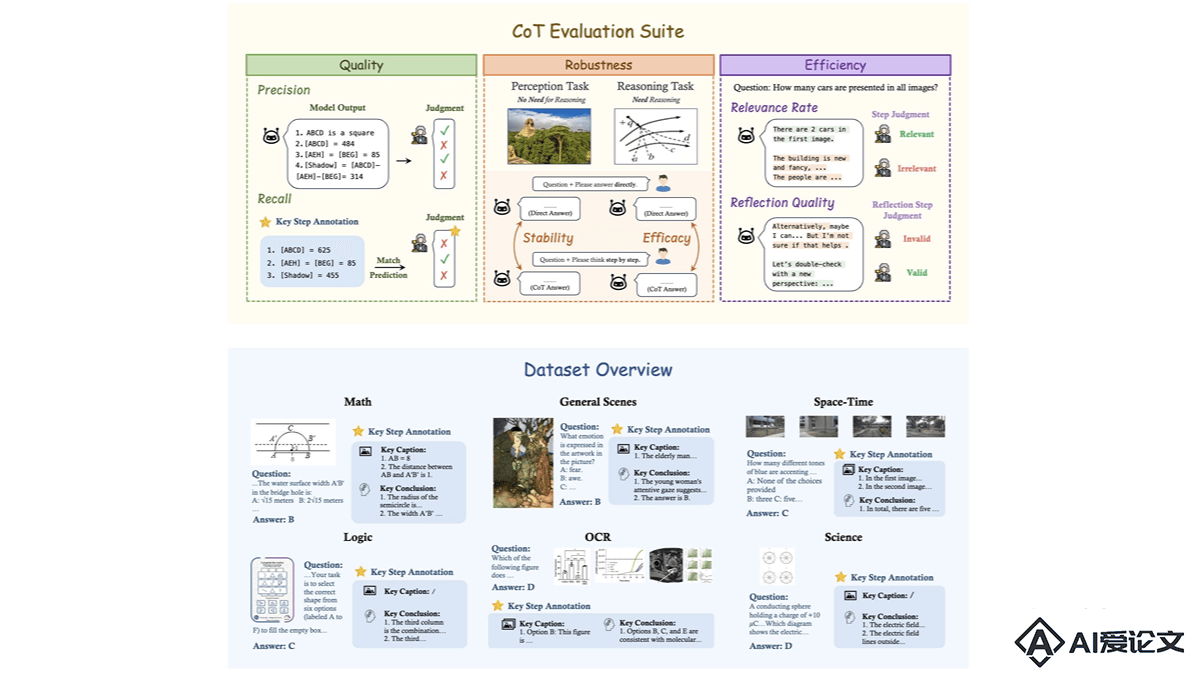

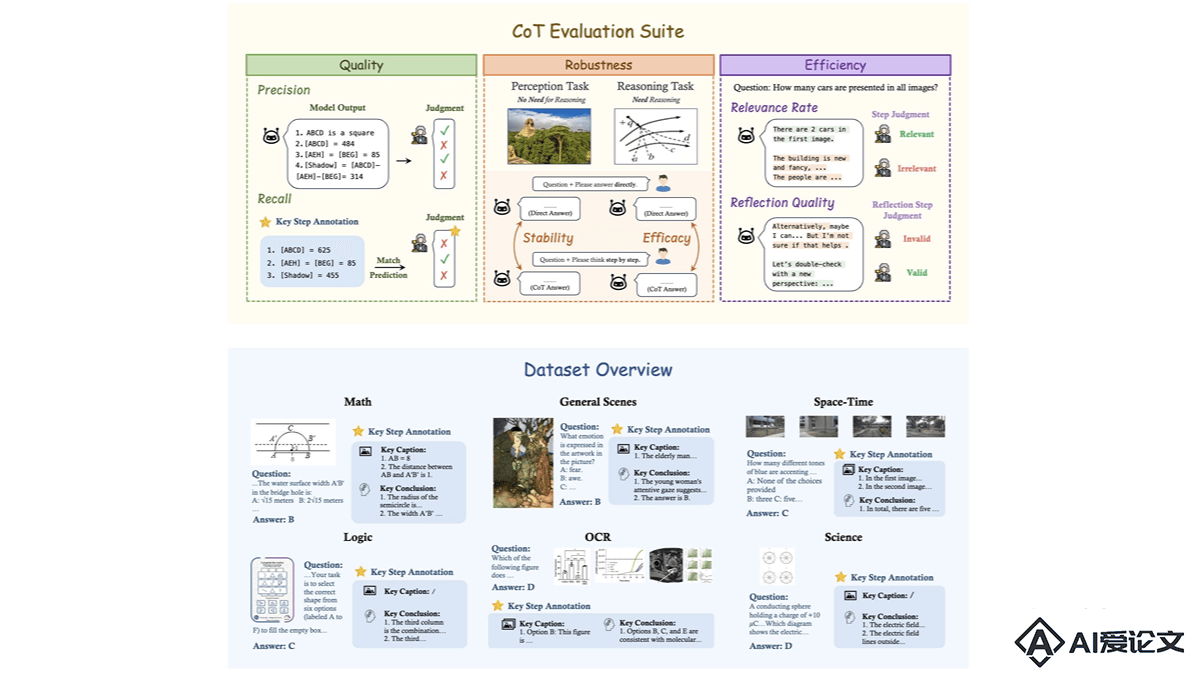

MME-CoT 是什么

MME-CoT 是香港中文大学(深圳)、香港中文大学、字节跳动、南京大学、上海人工智能实验室、宾夕法尼亚大学、清华大学等机构共同推出的用于评估大型多模态模型(LMMs)链式思维(Chain-of-Thought, CoT)推理能力的基准测试框架,涵盖数学、科学、OCR、逻辑、时空和一般场景等六个领域,包含1,130个问题,每个问题都标注了关键推理步骤和参考图像描述。MME-CoT 基准基于三个新颖的评估指标——推理质量(逻辑合理性)、鲁棒性(对感知任务的干扰)和效率(推理步骤的相关性)——对模型的推理能力进行全面评估。实验结果揭示了当前多模态模型在CoT推理中存在的一些关键问题,例如反思机制的低效性和对感知任务的负面影响。

MME-CoT 的主要功能

多领域推理能力评估:覆盖六个主要领域(数学、科学、OCR、逻辑、时空和一般场景),全面评估模型在不同场景下的推理能力。细粒度推理质量评估:基于标注关键推理步骤和参考图像描述,评估模型推理的逻辑合理性(质量)、鲁棒性(对感知任务的干扰)和效率(推理步骤的相关性)。揭示模型推理问题:揭示当前多模态模型在 CoT 推理中存在的问题,例如反思机制的低效性和对感知任务的干扰。为模型优化提供参考:提供的评估结果和分析为多模态模型的设计和优化提供重要的参考,帮助研究人员改进模型的推理能力。

MME-CoT 的技术原理

多模态数据集构建:构建高质量的多模态数据集,包含 1,130 个问题,覆盖六个领域和 17 个子类别。每个问题都标注关键推理步骤和参考图像描述,用在评估模型的推理过程。细粒度评估指标:推理质量:基于召回率(Recall) 和 精确率(Precision) 评估推理步骤的逻辑合理性和准确性。推理鲁棒性:基于稳定性(Stability) 和效能(Efficacy) 评估 CoT 对感知任务和推理任务的影响。推理效率:基于相关性比例(Relevance Rate) 和反思质量(Reflection Quality) 评估推理步骤的相关性和反思的有效性。推理步骤解析与评估:用 GPT-4o 等模型将模型输出解析为逻辑推理、图像描述和背景信息等步骤,逐一对步骤进行评估。

MME-CoT 的项目地址

项目官网:https://mmecot.github.io/GitHub仓库:https://github.com/CaraJ7/MME-CoTHuggingFace模型库:https://huggingface.co/datasets/CaraJ/MME-CoTarXiv技术论文:https://arxiv.org/pdf/2502.09621

MME-CoT 的应用场景

模型评估与比较:作为标准化基准,用在评估和比较不同多模态模型在推理质量、鲁棒性和效率方面的表现。模型优化:基于细粒度评估指标,揭示模型在推理过程中的问题,为优化模型提供方向。多模态研究:为多模态推理研究提供工具,帮助探索新的模型架构和训练方法。教育与培训:用于教育领域,帮助学生和研究人员理解多模态模型的推理逻辑。行业应用:在智能教育、自动驾驶、医疗影像等领域,评估和改进模型的实际应用表现。

相关资讯

相关资讯 2023-04-14

2023-04-14

下载

下载