GRUtopia 2.0 – 上海 AI Lab 推出的通用具身智能仿真平台

来源:爱论文

时间:2025-03-14 16:56:10

GRUtopia 2.0是什么

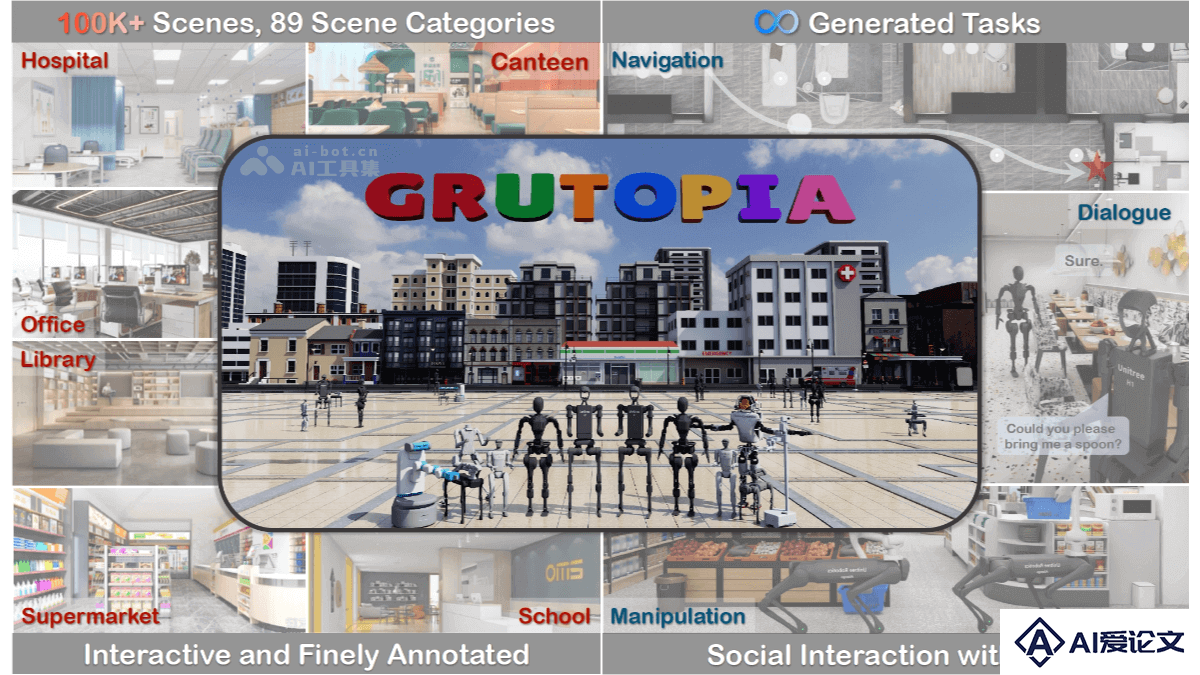

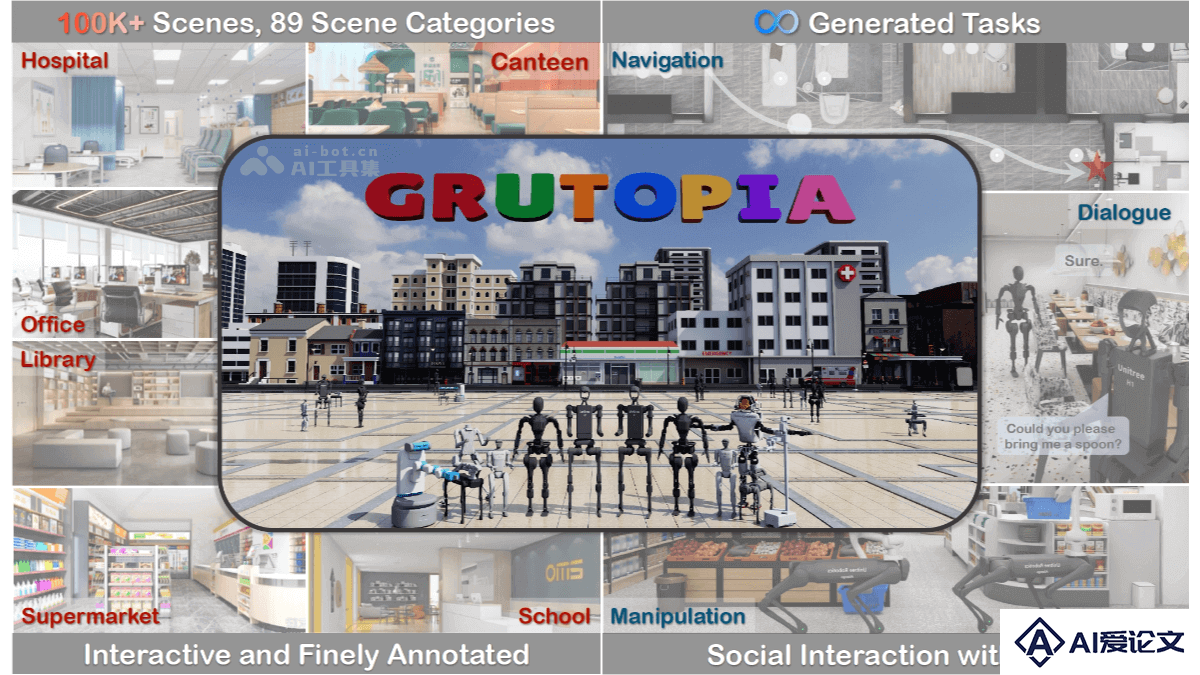

GRUtopia 2.0(桃源2.0)是上海人工智能实验室发布的通用具身智能仿真平台。平台在GRUtopia 1.0的基础上进行了全面升级,具备三大核心创新:通用模块化框架、场景资产自动化生成和高效数据采集系统。用户仅需通过“三行代码”可定义复杂任务,无需在多个平台之间切换。平台集成百万级标准化物体资产,可实现复杂场景的“一键生成”,降低开发成本。GRUtopia 2.0 支持多种具身智能任务,如导航、操作和运动控制。作为“虚实贯通”技术体系的核心,平台通过高性能仿真推动具身智能从虚拟走向现实。

GRUtopia 2.0的主要功能

通用模块化仿真框架:GRUtopia 2.0 引入了通用模块化仿真框架,支持导航、操作、运动控制等多种具身任务。用户仅需通过“三行代码”即可定义任意任务,无需在多个平台之间切换,极大地简化了开发流程。场景资产自动化生成:平台集成了百万级标准化物体资产,结合自动化生成和随机化工具,能实现复杂场景的“一键生成”。高效数据采集系统:GRUtopia 2.0 提供了面向操作任务的多种低门槛遥操作工具,面向导航任务的批量化数据采集工具。与传统方式相比,遥操作效率提升5倍,导航任务数据采集效率最高提升20倍。大规模交互式3D场景数据集(GRScenes):平台包含10万个高度交互和精细标注的场景,可自由组合成城市规模的环境。场景涵盖了89种不同的场景类别,弥补了服务型环境的空白。NPC系统(GRResidents):GRUtopia 2.0 引入了由大语言模型(LLM)驱动的NPC系统,负责社交互动、任务生成和任务分配。模拟了社交场景,为具身AI应用提供了新的维度。基准测试平台(GRBench):平台提出了GRBench,支持多种机器人,特别是以腿式机器人为主要智能体,评估执行物体导航、社交导航和移动操作等中等难度任务的能力。仿真到现实(Sim2Real)范式:GRUtopia 2.0 通过仿真平台展示了如何用仿真来缓解高质量数据的稀缺性,推动机器人技术从虚拟到现实的扩展和应用。支持多样化机器人:平台支持多种类型的机器人,包括人形机器人和腿式机器人,能满足从底层控制到高层决策的多层级研究需求。

GRUtopia 2.0的项目地址

Github仓库:https://github.com/OpenRobotLab/GRUtopiaarXiv技术论文:https://arxiv.org/pdf/2407.10943

GRUtopia 2.0的应用场景

机器人训练与开发:GRUtopia 2.0 提供了通用模块化仿真框架,支持导航、操作和运动控制等多种具身任务。开发者可以通过简单的“三行代码”定义任务,无需在多个平台之间切换。复杂场景构建:平台集成了百万级标准化物体资产,结合场景自动化生成和随机化工具,能实现复杂场景的“一键生成”。场景涵盖了家庭、餐厅、办公室、公共场所等多种环境,为机器人提供了多样化的训练场景。社交互动与任务生成:GRUtopia 2.0 引入了由大语言模型(LLM)驱动的NPC系统,能模拟社交互动、任务生成和任务分配。数据采集与优化:平台提供了高效的数据采集系统,支持面向操作任务的多种低门槛遥操作工具和面向导航任务的批量化数据采集工具。

相关资讯

相关资讯 2023-04-14

2023-04-14

下载

下载