MeteoRA – 南大推出高效可扩展的多任务嵌入框架

来源:爱论文

时间:2025-03-14 12:10:02

MeteoRA是什么

MeteoRA 是南京大学计算机科学与技术系的研究团队推出的用于大型语言模型(LLM)的多任务嵌入框架,将多个任务特定的 LoRA(低秩适配器)集成到一个基础模型中,实现高效的参数复用和自主任务切换。MeteoRA基于混合专家(MoE)架构,用可训练的门控网络动态选择最适合当前输入的 LoRA 适配器,无需显式任务指令。MeteoRA 提出 MoE 前向加速策略,基于自定义 GPU 核算子显著提升了推理效率,同时保持低内存开销。在实验中,MeteoRA 在多种任务上展现出与传统微调方法相当的性能,在复合任务中表现出色,支持在一个推理过程中解决多个子问题。

MeteoRA的主要功能

多任务适配器集成:将多个任务特定的 LoRA(低秩适配器)嵌入到一个基础 LLM 中,同时处理多种任务。自主任务选择与切换:无需人工指定任务意图,实现任务的自主切换。高效推理:提升多任务适配器的推理效率,同时保持低内存开销。复合任务处理:在单次推理中解决多个子任务,例如连续回答多个不同领域的问答,提升模型的灵活性和实用性。扩展性:支持多种 LoRA 适配器的集成,适用于不同任务和领域,扩展 LLM 的应用场景。

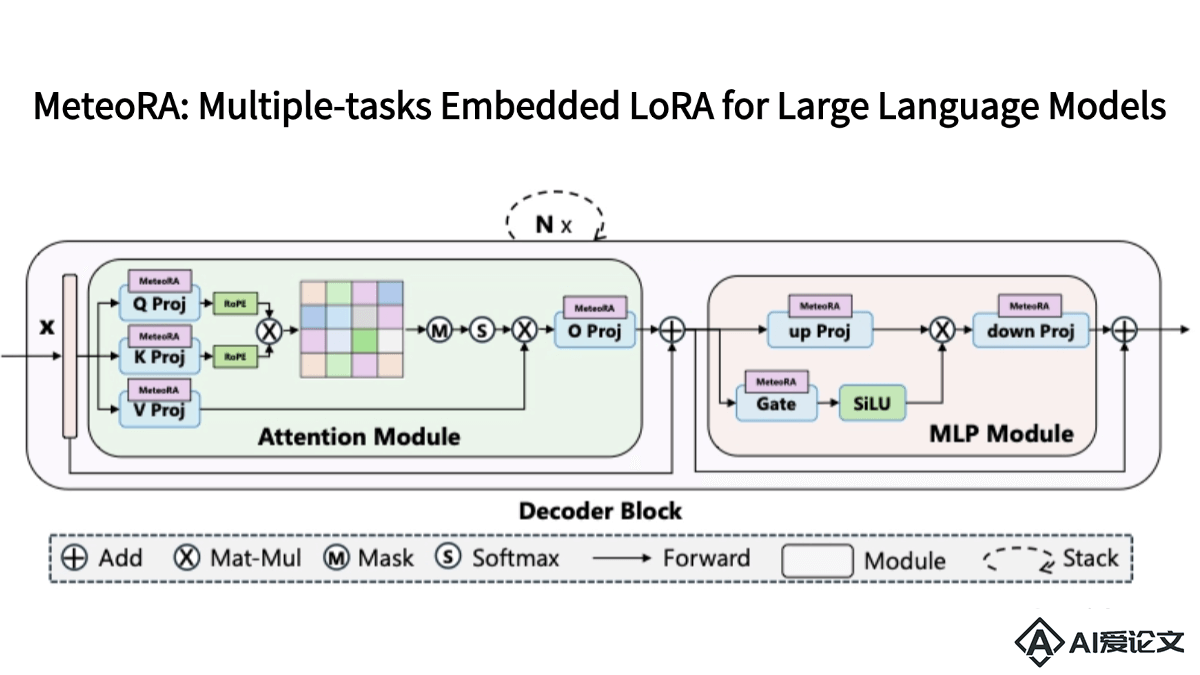

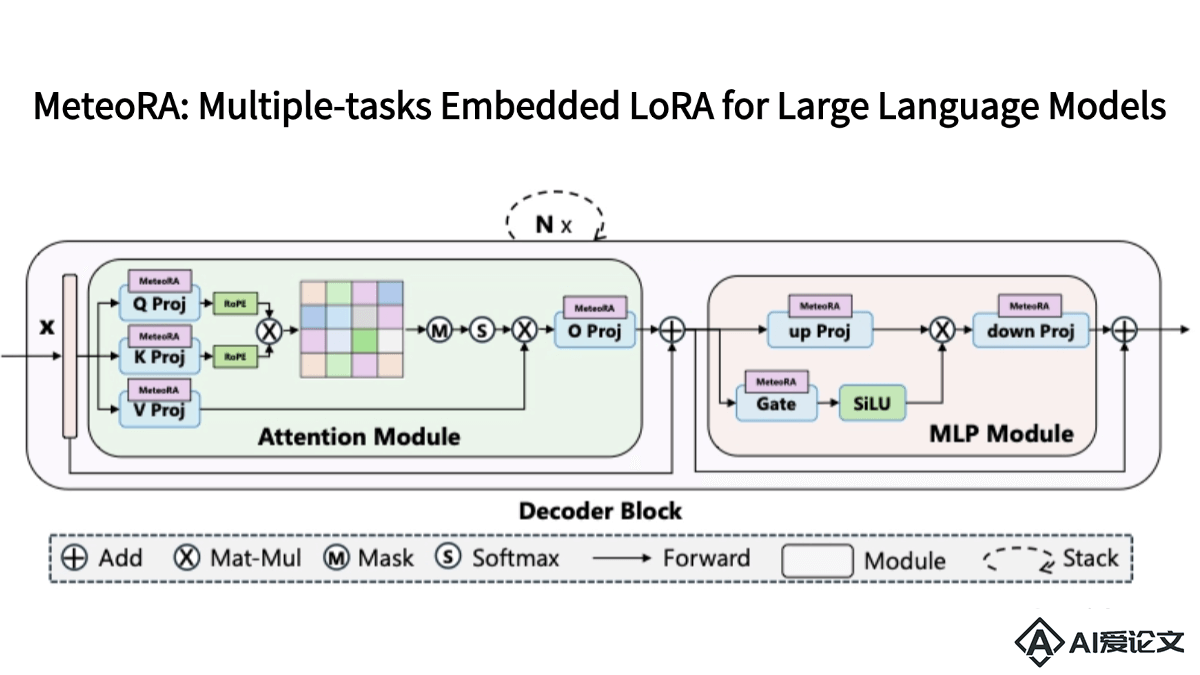

MeteoRA的技术原理

LoRA(Low-Rank Adaptation):一种参数高效的微调方法,基于在 LLM 的线性层中注入低秩矩阵(A 和 B),仅更新矩阵适应特定任务,不改变基础模型的其他参数。每个 LoRA 适配器包含一对低秩矩阵,用在修改模型的输出。混合专家(MoE)架构:基于 MoE 架构,将多个 LoRA 适配器视为不同的“专家”,通过一个可训练的门控网络动态选择最适合当前输入的专家(LoRA 适配器)。门控网络根据输入的隐藏状态计算每个 LoRA 的权重,选择权重最高的几个适配器进行前向传播。动态门控机制:门控网络为每个输入动态分配权重,决定哪些 LoRA 适配器参与计算。基于 top-k 选择策略,支持选择多个适配器,实现任务的灵活切换和组合。前向加速策略:推出基于 PyTorch 和 Triton 的自定义 GPU 核算子。算子基于并行化和优化内存访问,提升多任务推理的速度,同时保持较低的内存占用。全模式集成:将 LoRA 适配器嵌入到 Transformer 架构的所有线性层(包括注意力模块和 MLP 模块),更全面地利用不同任务的知识。

MeteoRA的项目地址

GitHub仓库:https://github.com/NJUDeepEngine/meteoraarXiv技术论文:https://arxiv.org/pdf/2405.13053

MeteoRA的应用场景

多领域问答:集成不同领域知识,自动切换适配器,精准回答各类问题。多语言对话:支持多种语言对翻译,实现流畅的多语言交流。复合任务处理:解决包含多个子任务的复杂问题,动态切换适配器完成任务。跨领域知识融合:结合不同领域知识,提升复杂任务处理能力。智能客服与助手:根据用户需求动态切换适配器,快速响应,提高服务质量。

相关资讯

相关资讯 2023-04-14

2023-04-14

下载

下载